I moderni data center devono far fronte a carichi termici sempre maggiori. Con l’aumento esponenziale della potenza di calcolo, spinto da applicazioni di intelligenza artificiale (AI), High Performance Computing (HPC) e cloud, i server generano quantità di calore senza precedenti. Oltre l’80% dei data center utilizza ancora principalmente il raffreddamento ad aria, ma ciò può incidere fino al 40% dei consumi energetici totali di una struttura digitale. Non sorprende dunque che circa il 40% degli operatori stia esplorando soluzioni di raffreddamento alternative, alla ricerca di metodi più ecologici ed economici. In questo contesto, il raffreddamento a liquido (liquid cooling) emerge come una risposta tecnologica avanzata e promettente, offrendo vantaggi significativi in termini di efficienza energetica, capacità di raffreddamento e sostenibilità ambientale.

Perché innovare il raffreddamento: limiti dell’aria e necessità emergenti

Nei primi data center, le ventole e i condizionatori d’aria erano sufficienti a dissipare il calore generato dai server. Oggi l’avvento di blade server ad alta densità, GPU per AI e sistemi HPC ha innalzato la densità di potenza per rack oltre i 30 kW, con proiezioni che superano i 100 kW in casi estremi. Questo approccio “forzato” comporta consumi energetici elevati e inefficienze: ad esempio, lo stesso sistema di raffreddamento ad aria può arrivare a consumare quasi metà dell’energia totale di un data center.

Il raffreddamento a liquido risponde a queste pressioni fornendo una soluzione capace di “catturare” e rimuovere il calore alla fonte in modo molto più efficiente rispetto all’aria. Inoltre, i liquidi possono raggiungere con facilità punti critici (come processori e GPU) tramite tubi o piastre, migliorando la precisione e l’efficacia del raffreddamento rispetto al flusso d’aria, che è difficile da convogliare miratamente.

Come funziona il liquid cooling nei data center

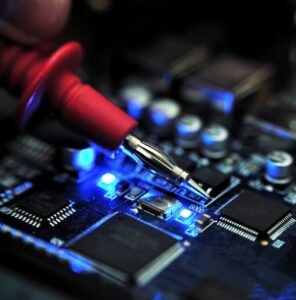

Liquid cooling significa utilizzare fluidi (tipicamente acqua o altri liquidi speciali) per assorbire il calore dai componenti IT e dissiparlo all’esterno. Esistono diverse architetture e metodi per implementare il raffreddamento a liquido in un data center.

In generale, un sistema a liquido prevede alcuni componenti chiave: piastre fredde o scambiatori di calore a contatto con le parti calde, tubazioni per convogliare il fluido, pompe che garantiscono la circolazione forzata, uno o più scambiatori di calore secondari per cedere il calore all’ambiente (spesso attraverso un circuito d’acqua refrigerata o un radiatore ad aria esterno), e infine unità di controllo come le CDU (Coolant Distribution Unit o Liquid Distribution Unit) che monitorano e regolano temperatura, portata e pressione del liquido. Di seguito passiamo in rassegna le due tipologie principali di raffreddamento a liquido per i server.

Raffreddamento diretto su chip (Direct-to-Chip)

Questa tecnologia ha già una lunga storia. È stata utilizzata per decenni nei supercomputer e perfino nel settore del gaming di fascia alta. L’efficacia termica del direct-to-chip è molto elevata, perché il calore viene catturato direttamente alla fonte (il die del processore) anziché affidarsi alla convezione dell’aria. Secondo alcune stime, i sistemi D2C riescono a dissipare fino al 70-75% del calore totale prodotto in un rack attraverso il circuito liquido. Un vantaggio chiave è la capacità di gestire carichi termici molto elevati: processori e acceleratori di ultima generazione con TDP (Thermal Design Power) altissimi possono essere tenuti in temperatura con maggiore facilità, consentendo di aumentare la densità computazionale (più potenza di calcolo concentrata per metro quadrato) senza rischio di surriscaldamento.

In pratica, si installano piastre metalliche raffreddate a liquido (dette cold plates) sopra i processori. Queste piastre sono attraversate internamente da piccoli canali in cui scorre l’acqua (opportunamente trattata) o un altro fluido refrigerante. Assorbendo calore dal chip, il liquido si riscalda e viene poi convogliato fuori attraverso un circuito chiuso. Uno scambiatore di calore esterno (che può essere un radiatore ad aria dry cooler posizionato fuori dall’edificio, provvede infine a raffreddare il liquido caldo e rimandarlo in circolo.

Va notato però che nei server sono presenti anche componenti secondarie (RAM, SSD/HDD, alimentatori) che generano calore ma che non sempre sono collegate al circuito a liquido. Una porzione residua del carico termico (circa il 30%) continua quindi a richiedere il raffreddamento ad aria tradizionale all’interno del chassis.

Raffreddamento a immersione

Il raffreddamento a immersione rappresenta l’altro grande approccio ai sistemi a liquido per data center moderni. In questo caso, invece di portare il liquido ai componenti, si fa il contrario: si immergono direttamente interi server (o blade, o schede) in un fluido dielettrico specializzato. Esistono due varianti di immersione: monofase e bifase.

In pratica, si hanno vasche di immersione (tank) riempite con questo fluido. I server vengono inseriti al loro interno e funzionano completamente immersi. Il calore generato dai componenti viene immediatamente trasmesso al liquido circostante; da qui, attraverso scambiatori di calore, l’energia termica viene poi trasferita a un circuito secondario (spesso ad acqua) che la porta all’esterno per lo smaltimento definitivo tramite radiatori o torre evaporativa. Ciò consente di gestire carichi termici estremamente elevati.

Un altro vantaggio notevole è che l’immersione elimina completamente la necessità di aria all’interno dei server. Si ottiene anche un ambiente silenzioso.

Vantaggi del raffreddamento a liquido nei data center

Implementare il liquid cooling in un data center può offrire una serie di benefici tangibili, che spaziano dall’efficienza tecnica fino agli aspetti economici e ambientali:

1. Efficienza energetica notevolmente superiore: Il primo vantaggio, immediato e misurabile, è la riduzione del consumo di energia elettrica per il raffreddamento. I sistemi a liquido sono molto più efficaci nel trasferire calore, per cui richiedono meno potenza per mantenere i server in temperatura rispetto ai sistemi ad aria.

2. Maggiore densità di calcolo e prestazioni: Eliminando il collo di bottiglia termico, il liquid cooling consente di ospitare hardware più potente in spazi ristretti. I processori e acceleratori moderni possono essere sfruttati al massimo delle performance senza incorrere in throttling termico, e si possono installare più server per rack anche superando densità impensabili con il solo air cooling.

3. Affidabilità e silenziosità operativa: Un ambiente termicamente stabile e pulito prolunga la vita delle apparecchiature IT. Raffreddare server e componenti in maniera omogenea tramite liquido evita stress termici e riduce l’incidenza di guasti legati al calore e alle dilatazioni. In sistemi a immersione, ad esempio, l’assenza di polvere e di sbalzi di temperatura contribuisce ad aumentare l’affidabilità di schede e alimentatori, e si è osservato un minore tasso di failure nel tempo.

4. Sostenibilità ambientale e risparmio idrico: Dal punto di vista “green”, il raffreddamento a liquido offre diversi spunti positivi. Primo, l’efficienza energetica maggiore si traduce in minori emissioni di CO2 per kilowatt di elaborazione, aiutando i data center a ridurre la propria carbon footprint e ad avvicinarsi agli obiettivi di sostenibilità. Secondo, molti sistemi a liquido riducono drasticamente il consumo di acqua rispetto ai sistemi ad aria con chiller e torri di raffreddamento.

Sfide e ostacoli del liquid cooling

A fronte dei notevoli vantaggi, l’adozione su larga scala del raffreddamento a liquido nei data center presenta anche una serie di sfide tecniche e operative che occorre considerare attentamente. Il passaggio dall’aria al liquido implica cambiamenti nell’infrastruttura e nei processi, con alcune criticità da superare.

1. Costi iniziali e ROI

L’implementazione di sistemi a liquido richiede un investimento iniziale considerevole. Questo è particolarmente vero per data center esistenti (brownfield), dove un retrofit a liquido può necessitare di modifiche sostanziali all’infrastruttura (es. rinforzo dei pavimenti rialzati per vasche pesanti, nuove linee di liquido, ecc.). Stanno emergendo modelli di business innovativi come il “Cooling-as-a-Service”, in cui fornitori specializzati installano e gestiscono l’impianto di liquid cooling e il cliente paga tramite abbonamento o consumo, evitando l’esborso iniziale elevato.

2. Complessità tecnica e manutenzione

Far funzionare e manutenere un data center a liquido è intrinsecamente più complesso rispetto a uno ad aria. Oltre alle competenze tradizionali IT/elettriche, il personale deve acquisire conoscenze in termoidraulica e gestione dei fluidi. Servono programmi di formazione specifici per tecnici e ingegneri, affinché siano in grado di gestire pompe, valvole, scambiatori e monitorare parametri come pressione e portata. La gestione dei liquidi dentro un data center introduce nuove procedure operative: ad esempio, per intervenire su un server D2C occorre scollegare i raccordi del liquido (il che va fatto senza causare perdite, grazie a connettori quick-disconnect per sostituire un server in immersione bisogna estrarlo dalla vasca e pulirlo dal fluido.

3. Integrazione e compatibilità con l’infrastruttura esistente

Nei data center già operativi, passare al raffreddamento a liquido non è un cambiamento banale. Molte strutture sono progettate attorno al flusso d’aria (hot aisle/cold aisle, controsoffitti per l’aria di ritorno, CRAC unit, ecc.) e non dispongono di un impianto idraulico interno per portare acqua refrigerata ai rack. In questi casi, l’integrazione può richiedere un approccio graduale o ibrido. Nelle nuove progettazioni, invece, si può pianificare fin dall’inizio un mix ottimale di raffreddamento.

4. Cambio di mentalità e competenze

Infine, un aspetto spesso sottolineato dagli esperti è il cambiamento culturale necessario per abbracciare il raffreddamento a liquido. Per decenni, i professionisti dei data center hanno lavorato in ambienti dove l’unico fluido in circolazione era l’aria, e l’idea di portare liquidi vicino ai server poteva sembrare rischiosa o controintuitiva. Oggi questa percezione sta cambiando, spinta dalla necessità, ma richiede comunque condivisione di conoscenze e best practice.

Applicazioni reali e tendenze recenti

Non si tratta più di teoria: il raffreddamento a liquido è già realtà in vari contesti e la sua adozione sta accelerando. Supercomputer e HPC sono stati pionieri in questo campo. Ma la novità è che anche i grandi operatori cloud e hyperscaler stanno investendo in queste soluzioni.

Ad esempio, Google ha implementato il raffreddamento a liquido diretto per le proprie unità AI TPU (Tensor Processing Unit) di ultima generazione, sviluppando blocchi di calcolo raffreddati ad acqua per allenare modelli di deep learning.

Meta (Facebook) sta sperimentando l’immersione liquida per i server dedicati all’AI e al metaverso, in collaborazione con l’Open Compute Project, per gestire i carichi termici unici di queste applicazioni.

Microsoft ha portato avanti un progetto curioso, Project Natick (ormai chiuso), mettendo data center in capsule sottomarine. Sul fronte dei fornitori industriali, giganti dell’infrastruttura come Schneider Electric, Vertiv, Dell e altri hanno lanciato linee di prodotti e reference design “AI-ready” con raffreddamento a liquido integrato, segno che il mercato si sta muovendo verso la maturità.

Una tendenza interessante è l’abbinamento del liquid cooling con energie rinnovabili e sistemi di backup energetico.

Un altro filone di sviluppo riguarda i fluidi avanzati: aziende chimiche stanno studiando nanofluidi (particelle ad alta conducibilità disperse in liquidi per aumentarne la capacità termica) o fluidi a cambiamento di fase innovativi, per spingere ancora più in là le prestazioni termiche. Allo stesso modo, si ricerca in materiali più resistenti e sostenibili per tubazioni, guarnizioni e componenti interni ai server (ad esempio coating idrofobici per le schede immerse, o leghe anticorrosione per i waterblock).

Conclusioni

Il liquid cooling rappresenta una rivoluzione silenziosa nell’ambito dei data center, destinata a giocare un ruolo chiave nell’evoluzione delle infrastrutture digitali nei prossimi anni. Le sfide termiche poste dalle nuove tecnologie stanno rendendo sempre più evidente l’inadeguatezza dei soli sistemi ad aria. Il raffreddamento a liquido offre una soluzione efficace a queste sfide, con vantaggi concreti: maggiore efficienza energetica, supporto a densità di calcolo elevate, migliore sostenibilità ambientale e opportunità di recupero del calore. Allo stesso tempo, richiede un cambio di paradigma nella progettazione e gestione dei data center, introducendo nuove complessità e necessità di competenze interdisciplinari. Entro la fine del decennio, è plausibile che i data center di fascia alta, specialmente quelli orientati all’AI, saranno raffreddati prevalentemente a liquido, e le best practice sviluppate verranno via via estese anche ad infrastrutture più piccole. Le sfide non mancano, ma con ricerca, innovazione e pianificazione, i vantaggi superano gli ostacoli. E l’idea di server che “bollono” in un bagno refrigerante potrebbe diventare la nuova normalità nell’industria dell’IT.

Fonte: www.fareelettronica.it